Anthropic ai per raid aerei in iran | rischi etici e controversie sul divieto claude

Recentemente, Anthropic ha annunciato l’impiego della sua intelligenza artificiale per coordinare raid aerei in Iran, suscitando reazioni e dibattiti tra le principali aziende tecnologiche. Le autorità governative hanno adottato decisioni specifiche riguardo all’utilizzo di questa tecnologia, mentre le aziende coinvolte hanno risposto in modo diverso alle controversie sollevate. La questione riguarda soprattutto i rischi etici e le restrizioni sul divieto di utilizzo di Claude.

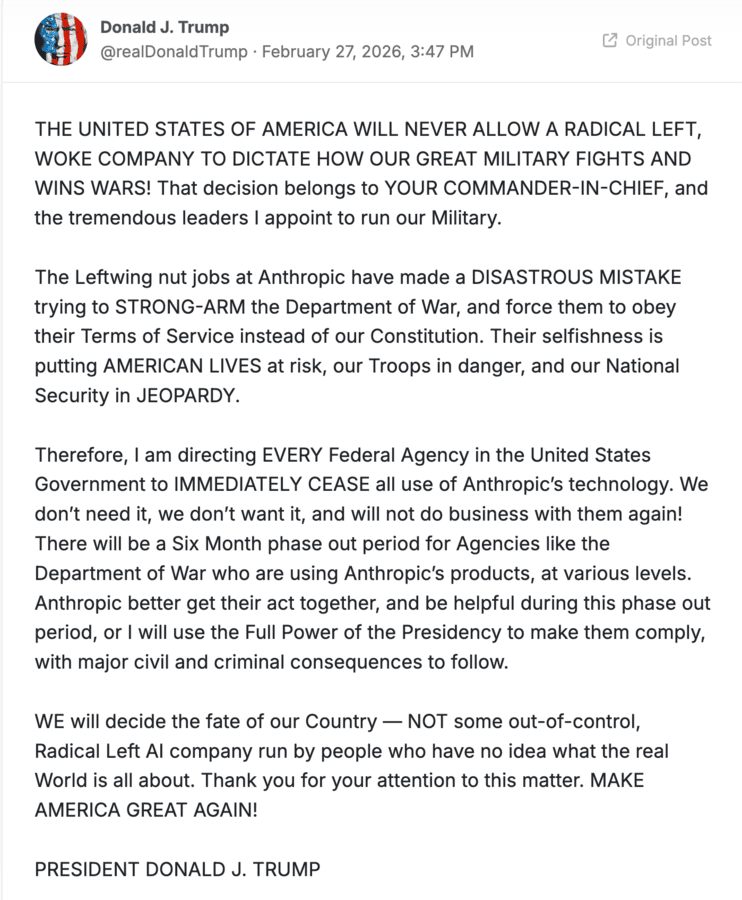

Questo intervento offre un quadro sintetico delle decisioni governative sull’uso dell’IA sviluppata da Anthropic e delle risposte delle principali realtà tecnologiche coinvolte. si analizzano le mutate dinamiche tra il dipartimento della difesa, l’azienda titolare di Claude e i partner industriali, evidenziando le implicazioni operative e le resistenze etiche e legislative emerse durante l’evoluzione della vicenda. il 27 febbraio, l’amministrazione federal ha disposto lo stop immediato all’impiego di Claude all’interno delle agenzie governative. la decisione è stata preceduta da mesi di negoziato tra il dipartimento della difesa e Anthropic, con richieste mirate a rimuovere i limiti etici sull’uso militare e a consentire la sorveglianza di massa sui cittadini statunitensi non controllata dall’intervento umano. 🔗 Leggi su Mondoandroid.com

US used Anthropic’s Claude during the Venezuela raid, WSJ reportsFeb 13 (Reuters) - Anthropic’s artificial-intelligence model Claude was used in the U.

Il Pentagono contro Claude, l'AI di AnthropicLe dimissioni da Anthropic del capo della sicurezza e il dilemma: fare bene o fare veloci? Il segretario alla Difesa americano, Pete Hegseth, è...

Una raccolta di contenuti su Anthropic.

Temi più discussi: Anthropic non vuole che la sua AI venga usata per uccidere o sorvegliare, ma il governo americano ha altri piani; Le minacce di Hegseth ad Anthropic per condividere la propria tecnologia; Anthropic sfida il Pentagono sull’IA: no a sorveglianza di massa e armi autonome; Anthropic e Pentagono, è scontro aperto: qui si gioca il futuro.

Anthropic snobba la spinta del Pentagono ad aprire Claude AI per i sistemi di armi senza pilota o per l'uso della sorveglianza di massaAnthropic rimarrà probabilmente l'azienda leader nel settore dell'AI per quanto riguarda la sicurezza e la responsabilità sociale dei suoi modelli. Nonostante tutte le potenziali ripercussioni, ha rif ... notebookcheck.it

Anthropic non vuole che la sua AI venga usata per uccidere o sorvegliare, ma il governo americano ha altri pianiIl dipartimento della Difesa sta minacciando l'azienda di intelligenza artificiale, che si è opposta agli impieghi militari della sua tecnologia ... wired.it

Anche in Italia Claude di Anthropic fa un balzo in avanti tra le app più scaricate nelle ultime 24/48 ore. Questa è la categoria Produttività su Android e l'app passa dalla 13° posizione di ieri, alla 4° di oggi. x.com

L’amministrazione dichiara Anthropic “minaccia alla sicurezza nazionale” ma affida ai suoi algoritmi la missione contro Teheran facebook