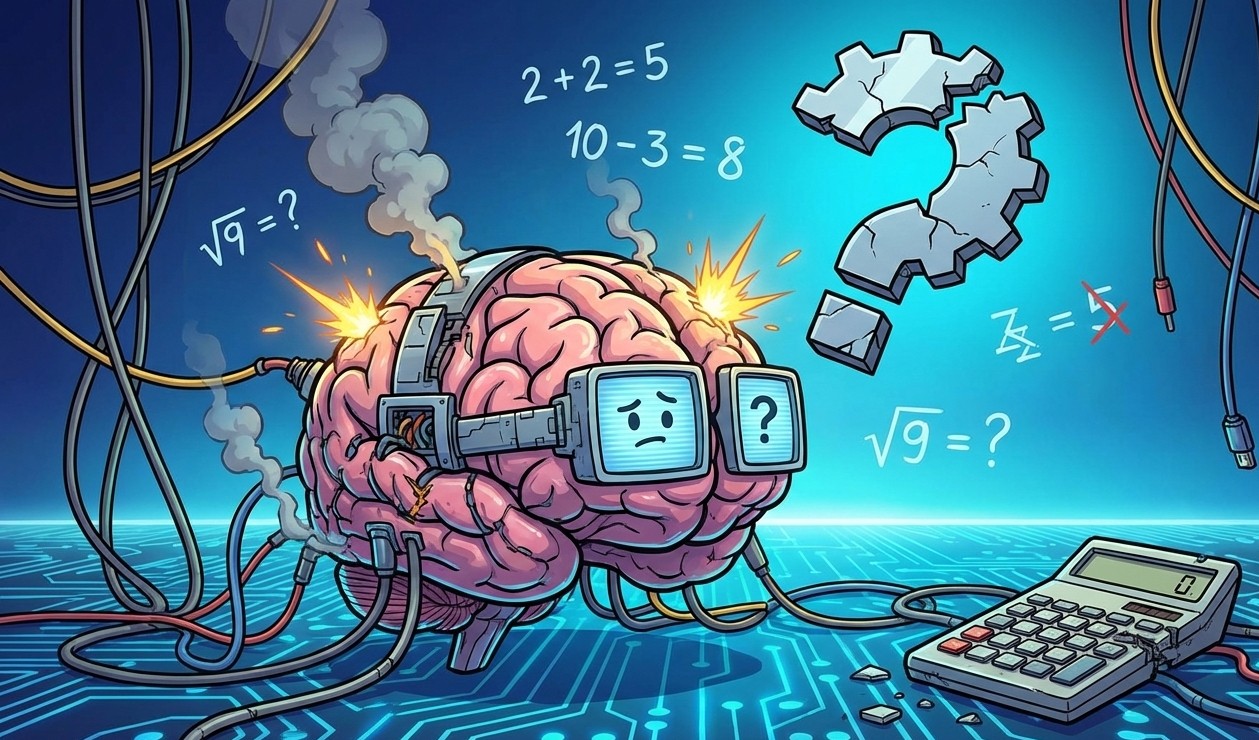

Lacuna logica nei modelli di intelligenza artificiale | perché la matematica di base li mette in difficoltà

Negli ultimi mesi, i modelli di intelligenza artificiale come Gemini, ChatGPT e Claude hanno mostrato grandi miglioramenti, ma spesso commettono errori di logica. La causa principale risiede nella loro difficoltà a manipolare correttamente le regole di base della matematica. Questo problema si manifesta quando devono affrontare problemi semplici che richiedono una comprensione logica elementare. La loro performance cala soprattutto in compiti che richiedono un ragionamento lineare e preciso.

Le prestazioni di modelli di intelligenza artificiale moderna possono evocare la magia: sistemi come Gemini, ChatGPT e Claude mostrano una capacità di risoluzione rapida e di generazione creativa. Una ricerca condotta da ricercatori di Stanford, Caltech e Carleton College mette in luce lacune profonde che compromettono persino attività logiche di base, rivelando una realtà meno sorprendente ma cruciale per l’affidabilità della tecnologia. intelligenza artificiale senza una teoria della mente umana e i fallimenti logici. Un aspetto particolarmente significativo riguarda l’ intelligenza sociale: gli esseri umani apprendono regole e sfumature morali attraverso esperienze reali nel tempo, mentre l’IA manca di una teoria della mente che consenta di intuire cosa potrebbe pensare un interlocutore o di prevedere comportamenti basati su principi etici.🔗 Leggi su Mondoandroid.com

Google photos aggiunge modelli di creazione con intelligenza artificiale su iphoneGoogle Photos ha lanciato una nuova funzione chiamata Create with AI, che permette di creare contenuti con l’aiuto dell’intelligenza artificiale.

Modelli di intelligenza artificiale tra i principali bersagli degli attacchi avverte googleGoogle avverte che i modelli di intelligenza artificiale sono sempre più attaccati dai cybercriminali.

Vedi altri contenuti disponibili per approfondire la notizia o scorri a sinistra ← per la prossima news.È avvilente notare la subdola logica dei NO: se voti SÌ, stai dalla parte dei ladri, contro i magistrati e sei certamente fascista. Se voti NO, invece, sei antifascista e onesto. E sei pure colto, bello, buono e intelligente. Sempre solito metodo che la stragrande magg - facebook.com facebook